「人間ならどうするか」ではなく、「AIならどうするか」。

哲学の思考実験として長く議論されてきたトロッコ問題が、いま再び注目されています。

その理由は、AIや自動運転車の判断に、この古典的な問題が現実の課題として関わっているからです。

人工知能が人間に代わって判断を下す時代に、トロッコ問題の問いは抽象的な道徳の話にとどまりません。

私たちは、AIにどんな「価値観」や「選択ルール」を組み込むべきかという、現実的で避けがたい問いに直面しています。

本記事では、トロッコ問題をAIの視点から再検討し、自動運転車やAI倫理の課題についてやさしく解説します。

また、子どもと一緒に「機械が命を選ぶってどういうこと?」を考えるヒントもご紹介します。

トロッコ問題の基本を知りたい方は、こちらの記事もぜひご覧ください。

トロッコ問題がAIと関係する理由

トロッコ問題は、人間が道徳的ジレンマに直面したとき、どのような選択をするかを問うものでした。

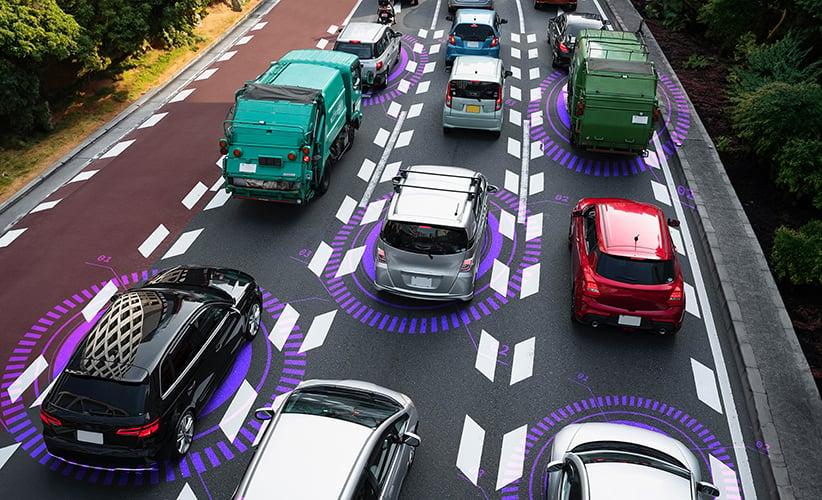

しかし、AIや自動運転技術が登場してから、その「選択」を人間だけでなく機械が行う必要が出てきたのです。

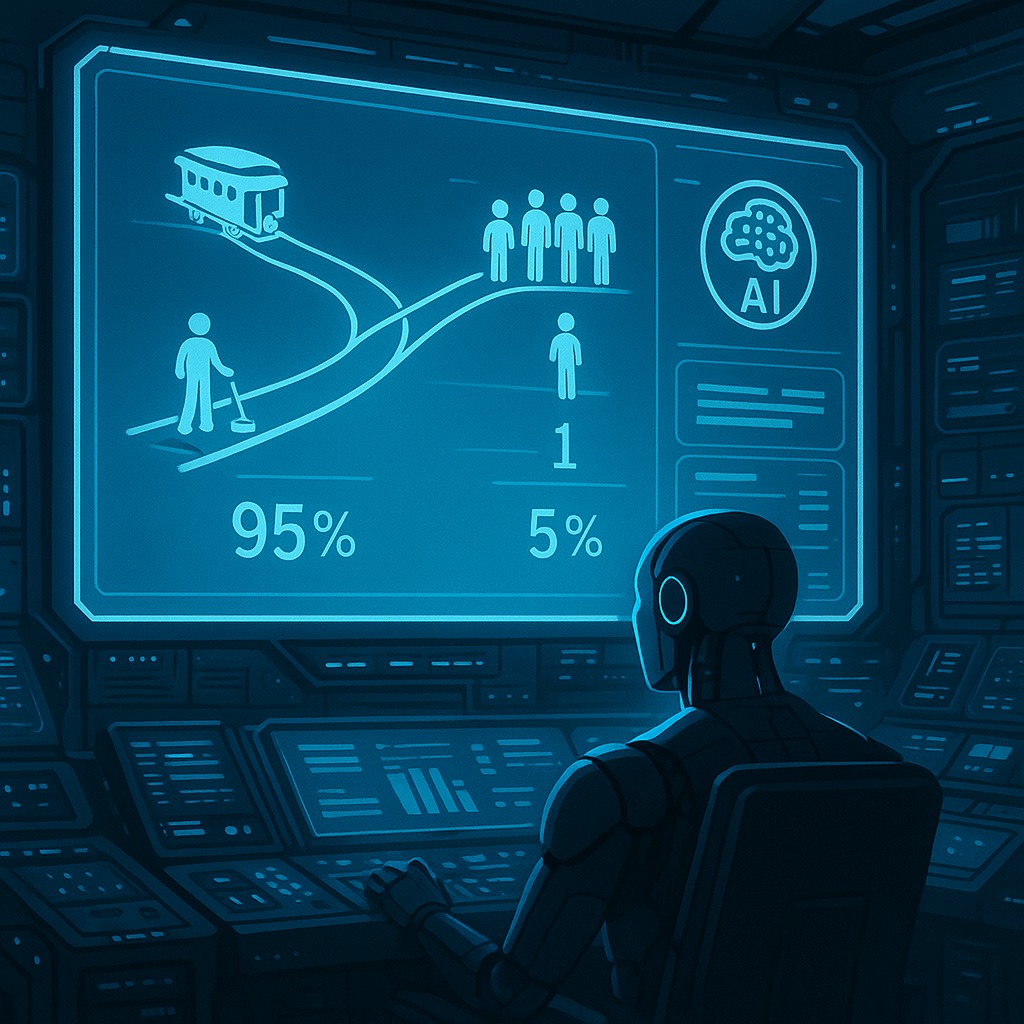

たとえば、自動運転車が走行中、前方に避けられない事故が迫っているとします。

右にハンドルを切れば歩行者が1人犠牲になり、左に切れば5人が巻き込まれる──まさに現代版トロッコ問題です。

このような極端な状況は頻繁に起きるわけではありません。

しかし、いざという時、**AIが「誰を助け、誰を犠牲にするか」**という判断を下さなければならない現実は、すでに目前にあります。

モラル・マシン実験:世界がどう考えているか

MIT(マサチューセッツ工科大学)が行った「Moral Machine(モラル・マシン)」というプロジェクトでは、世界中の人々が仮想のトロッコ問題にどのように答えるかを調査しました。

この実験では、自動運転車が事故の直前にとるべき行動を問う問題が多数出題されます。

年齢・性別・社会的地位・人間かどうか(ペットも含む)といった条件の中から、「誰を助けるべきか」を選ばされるというものです。

結果、各国の文化によって回答傾向が異なることが明らかになりました。

- アメリカなどの欧米諸国では「若者を優先」

- 中国や韓国などでは「高齢者を尊重」

- 一部の地域では「守るべき法律を守ったか」が基準になる

つまり、「命の価値」そのものが国や文化、個人の価値観によって異なるのです。

そしてその価値観をAIにどう反映させるかが、大きな問題になっています。

AIは倫理を学べるのか?

現在のAIは、命の重さを自分で判断するわけではありません。

あくまで人間が与えたルールに従って判断を「シミュレーション」しているにすぎません。

とはいえ、AIが人間と同じように「倫理的に正しい判断」をするように設計する試みは続いています。

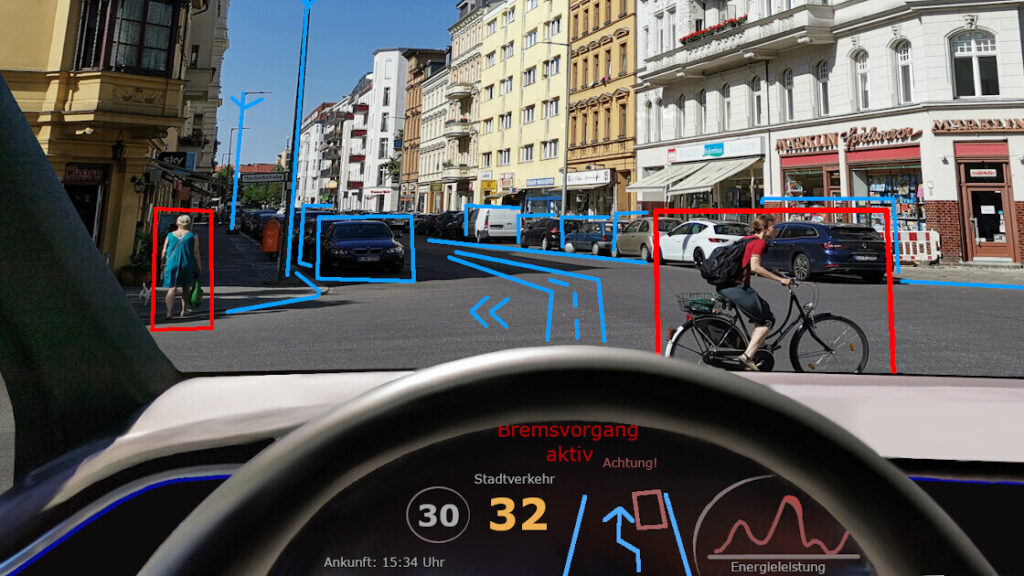

このような取り組みは「AI倫理」「説明可能なAI(XAI)」と呼ばれます。

その目的は、AIがどのようなロジックで判断を下したのかを、人間が理解できるようにすることです。

たとえば、AIが以下のような基準で判断するよう設計されるとします。

- 最も被害が少ない選択を優先(功利主義的)

- 法律を順守する判断を優先

- 自分の乗員を第一に守る(製品安全)

このようにルールを決めても、「それが本当に倫理的か?」という新たな問いが生まれてしまいます。

AIが判断する時代に必要な「人の関与」

トロッコ問題に「正解」がないのと同じように、AIの判断にも唯一の正解は存在しません。

むしろ、AIが自律的に行動するからこそ、その設計や運用には人間の深い関与が必要になります。

たとえば自動運転車を開発する企業は、トロッコ問題的な状況にどう対処するのか、設計段階で明確にしておく必要があります。

そしてその方針を、消費者や社会全体に説明責任を果たす必要があります。

ここにこそ、AI社会における「倫理設計」の重要性があるのです。

ChatGPTにトロッコ問題を聞いてみたら?

実際に、AIであるChatGPTにトロッコ問題を問うと、次のような答えが返ってきます。

「功利主義的な立場からは、多くの人を救うために1人を犠牲にするのが合理的とされます。ただし、それは道徳的に正しいとは限りません。」

つまり、AIは論理的に整理された意見を返しますが、最終的な選択は人間に委ねる姿勢を保っているのです。

AIにできるのはあくまで補助であり、判断するのはあくまで人間。

この姿勢は、今後ますます重要になるでしょう。

親子トークタイム!子供に伝える方法

AIと倫理の話題は、一見すると難しそうに思えるかもしれません。

でも、子どもにとっても「命の選択をロボットがするってどういうこと?」というのは、とても興味深いテーマです。

話す時には、ゲームやアニメに出てくるロボットの話などを例にすると、ぐっと身近になります。

子供にこう話してみよう!

「もし車が自動で動くようになって、事故が起きそうなときに、コンピューターが『右に行けば1人、左に行けば5人』って決めなきゃいけなくなったら、どうしたらいいと思う?」

「ロボットが命をえらぶって、ちょっとこわい? それとも便利だと思う?」

こんな問いかけから始めてみましょう。

子どもは直感的に「それはイヤ」「自分がえらばれたらどうしよう」と答えるかもしれません。

でもその反応こそが、倫理的な感受性のスタートラインです。

答えを急がず、「どうしてそう思ったの?」と寄り添うことで、自然な思考力が育っていきます。

まとめ

トロッコ問題は、今や哲学だけの話ではありません。

AIや自動運転の現場で、現実の問題として扱われている「命の選択」の問題です。

AIが人間のように判断する時代に、私たちはどんな価値観を機械に教えるべきなのか。

その問いに明確な答えはなく、むしろ問い続ける姿勢こそが大切です。

子どもと一緒に、「AIが命を選ぶこと」について語り合うことは、未来の社会に必要な力を育む第一歩です。

トロッコ問題の基礎を知りたい方は、こちらの記事へ。

また、ゲームでトロッコ問題を体験したい方は、トロッコ問題ゲームまとめもおすすめです。